En zonas de guerra, la desinformación en las redes sociales está costando vidas

hace 3 años

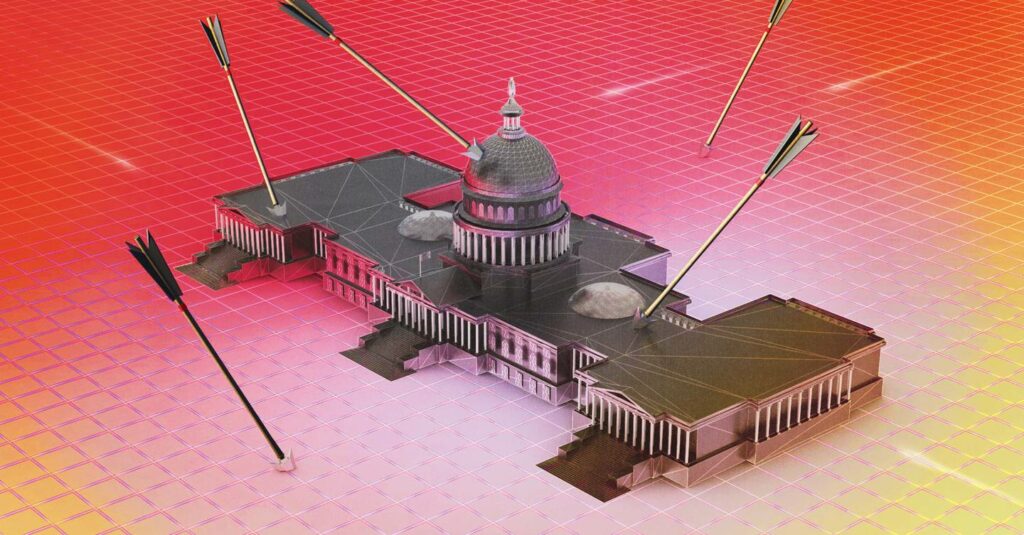

Cuando los alborotadores irrumpieron en el Capitolio de los Estados Unidos el 6 de enero, las plataformas de redes sociales ya no pudieron negar su papel en socavar la democracia. Mark Zuckerberg admitió que el riesgo de permitir el acceso continuo de Donald Trump a Facebook era "demasiado grande" después de que el entonces presidente de Estados Unidos parecía estar incitando a los insurgentes a través de sus cuentas de redes sociales. Twitter reconoció que los tuits de Trump podrían “inspirar a otros a replicar los actos violentos” contra el corazón de la democracia estadounidense.

Pero Trump no es el único líder autoritario que abusa de las redes sociales, y Estados Unidos no es el único país que lo sufre. Se están desarrollando variaciones de esta historia en Filipinas, Camerún, Libia y una docena de otros países que rara vez aparecen en los titulares.

La organización para la que trabajamos, el Centro para el Diálogo Humanitario, ha pasado los últimos 20 años mediando conversaciones de paz. Nos sentamos entre los grupos rebeldes y los gobiernos e intentamos forjar un alto el fuego y negociaciones políticas. Es un trabajo arriesgado que no siempre da sus frutos. En los últimos años, un nuevo fenómeno ha dificultado mucho un trabajo ya difícil: las redes sofisticadas de información errónea y desinformada en las redes sociales.

Tomemos a Libia, donde las Naciones Unidas están manteniendo conversaciones de paz para poner fin a años de lucha. Mientras negocian la paz dentro de un hotel en Túnez, cuentas falsas que se originan fuera de Libia están avivando las llamas de la guerra en Facebook y Twitter. Han denunciado corrupción, han hecho circular acuerdos falsos y han pedido violencia contra los involucrados en las conversaciones.

En Colombia, las redes sociales se utilizaron para socavar deliberadamente la legitimidad de las conversaciones de paz del gobierno con los rebeldes de las FARC, lo que en última instancia contribuyó al fracaso del acuerdo para aprobar un referéndum público.

En otros lugares, el vínculo entre las redes sociales y la violencia es aún más directo: vea la advertencia sobre Myanmar, donde la desinformación en Facebook estuvo ampliamente implicada en el genocidio rohingya. ¿Entonces qué debería ser hecho?

En primer lugar, no debemos esperar hasta después del hecho para actuar. Fue necesario un genocidio en Myanmar y una insurrección en Washington para conseguir plataformas para tomar medidas concertadas para abordar la violencia. Pero no es como si no hubiera señales de advertencia.

Buscar esas señales no es fácil en una zona de guerra. Requiere conocimiento del idioma local y una comprensión del contexto que los algoritmos no pueden proporcionar. Encontrar personas que tengan esas habilidades es difícil, pero las empresas deben hacerlo mejor. Su cobertura del "resto del mundo" sigue siendo drásticamente escasa de recursos. Si las empresas de redes sociales continúan ofreciendo sus servicios en estados frágiles donde el riesgo de violencia es alto, deben invertir seriamente para limitar el daño que pueden causar sus plataformas.

Y precisamente porque las zonas de guerra son complicadas, las plataformas deberían escuchar más a aquellos cuyo trabajo es comprender y abordar los conflictos: organizaciones como la ONU o investigadores especializados en desinformación. Estas personas podrían orientar a las plataformas sobre cómo la desinformación puede incitar a la violencia y alertarlas antes de eventos que puedan atraer desinformación. Por ejemplo, si se programa una ronda crucial de conversaciones de paz, se podría informar a las empresas de redes sociales para que puedan aumentar sus recursos y su seguimiento. Ni los mediadores ni las plataformas están teniendo este tipo de conversación en este momento.

Eso es un problema. Ahora es un lugar común que las empresas de redes sociales adopten medidas especiales en torno a las elecciones, con la adopción de estrictas reglas de moderación y la inversión de recursos adicionales para hacerlas cumplir. La razón es obvia: las elecciones son un proceso cívico importante y lo que sucede en línea puede socavar su integridad. Pero lo mismo puede decirse de las conversaciones de paz, que a menudo determinan no solo quién está en el gobierno, sino también los componentes básicos del estado.

Con tanto en juego, no sorprende que tales negociaciones atraigan a saboteadores. Cada guerra tiene individuos invertidos en más conflictos, y muchos de ellos están adquiriendo capacidades de operaciones de información sofisticadas, ya sea de forma independiente o de patrocinadores extranjeros.

Es por eso que las redes sociales necesitan una política para las conversaciones de paz, una que comience con estar consciente de ellas. En este momento, el personal de Facebook se sienta regularmente para mirar los calendarios electorales y decidir cuál podría conducir a la violencia, asignando los recursos de la empresa en consecuencia. Pero no existe un proceso en el que la empresa busque países que entren en un delicado proceso de negociaciones. Este vacío debe llenarse.

Las empresas no necesitarían reinventar la rueda. Muchas de las políticas implementadas por Facebook y Twitter en torno a las elecciones podrían adaptarse para proteger las conversaciones de paz. La información errónea sobre las conversaciones podría etiquetarse en los idiomas locales, con enlaces a información genuina, como declaraciones oficiales de la ONU. El contenido que tiene como objetivo intimidar a los negociadores debe eliminarse o etiquetarse. Todo esto se puede hacer de una manera que aún permita una crítica legítima del proceso.

Dicho esto, si bien las empresas de redes sociales claramente necesitan dar un paso al frente, debemos ser realistas sobre cuánto harán realmente para proteger la paz. Por muy mala que sea la guerra civil de Libia, nunca recibirá tanta atención como lo que sucede en Estados Unidos. También hay límites en cuanto a lo que puede lograr el “whack-a-mole” en las redes sociales. Derribar redes y cuentas hace la vida más difícil para los malos actores, pero regresarán con otro disfraz en poco tiempo. Etiquetar la información errónea después de que ha aparecido no cambiará la opinión de muchos.

El desafío es detener el problema en su origen. ¿Podrían los mediadores persuadir a las partes en conflicto de que dejen no solo sus armas, sino también sus cuentas falsas de Facebook? ¿Son posibles los altos el fuego digitales? No sería fácil. Pero vale la pena intentarlo, ya que nada haría una mayor diferencia que lidiar con el problema antes de que llegue a las plataformas de redes sociales en primer lugar.

Las barreras son menos empinadas de lo que suponen muchos pacificadores. A menudo, los mediadores sienten erróneamente que lo que sucede en línea es demasiado opaco para hacer algo al respecto. Pero la capacidad de detectar operaciones de información existe, en organizaciones como Graphika, el Stanford Internet Observatory y el Atlantic Council. La ignorancia ya no es una excusa.

Luego, depende de los mediadores encontrar una manera de persuadir y presionar a los que están en la mesa de negociaciones para que ejerzan la moderación, tanto en línea como fuera de línea. Al igual que en cualquier negociación, si una parte es mucho más poderosa que la otra, no será fácil encontrar un compromiso. Pero si todo el mundo está sufriendo, tal vez pueda surgir una distensión en línea.

Estamos en un punto de inflexión en la historia de la gran tecnología. La pregunta es si queremos que el debate se centre estrictamente en la defensa de la democracia occidental, o adoptemos una visión más amplia, que incluya países en guerra donde se ha demostrado que las redes sociales causan daños en el mundo real. Arreglar el mundo en línea será una tarea sencilla, pero al igual que poner fin a las guerras en el mundo real, tenemos que intentarlo. No esperemos hasta la próxima limpieza étnica instigada por el discurso de odio en línea para tener esta conversación.

Maude Morrison es asesora de mediación de conflictos y redes sociales en el Center for Humanitarian Dialogue. Adam Cooper es director senior de programas en el Center for Humanitarian Dialogue

Más historias geniales de Mundo Informático

🏎️ Lewis Hamilton se sincera sobre el activismo y la vida más allá de la F1

🌊 Seaspiracy de Netflix explora los impactos de la sobrepesca. Pero, ¿hará que la gente cambie su comportamiento?

🎧 ¿Qué servicio de transmisión de música debería elegir? Probamos Spotify, Apple Music y más

🔊 Escuche The Mundo Informático Podcast, la semana de ciencia, tecnología y cultura, que se entrega todos los viernes

👉 Siga Mundo Informático en Gorjeo, Instagram, Facebook y LinkedIn

Si quieres conocer otros artículos parecidos a En zonas de guerra, la desinformación en las redes sociales está costando vidas puedes visitar la categoría Otros.

Otras noticias que te pueden interesar